O que são Redes Neurais?

24/09/2024

Redes neurais são sistemas de computação inspirados na estrutura e funcionamento do cérebro humano, concebidos para simular a capacidade de aprendizado dos seres humanos. Pesquisadores as desenvolveram para atuar no campo da inteligência artificial (IA), sendo amplamente utilizadas em tarefas como classificação de informações e previsão de resultados complexos. Além disso, elas desempenham papéis importantes em áreas como reconhecimento de voz, visão computacional e processamento de linguagem natural.

Estrutura de uma Rede Neural

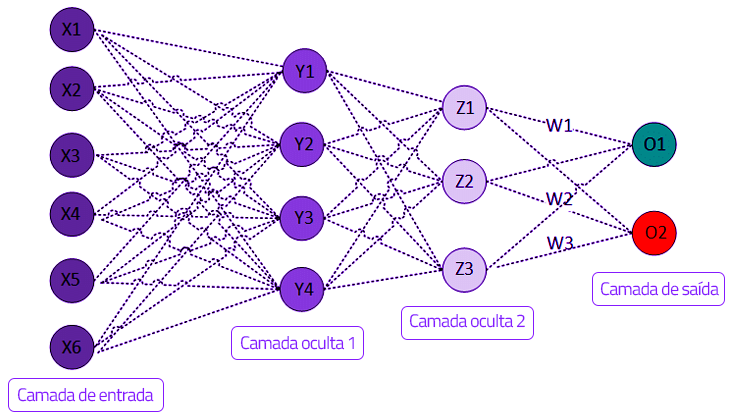

A estrutura de uma rede neural é organizada em nós (neurônios artificiais) que se conectam uns aos outros através de camadas distintas. Esses nós são equivalentes aos neurônios biológicos e são a unidade básica de processamento nas redes neurais.

Camada de Entrada: É onde os dados brutos do mundo real são introduzidos na rede. Cada neurônio desta camada representa uma característica (ou input) do conjunto de dados.

Camadas Ocultas: Entre a camada de entrada e a camada de saída, encontram-se as camadas ocultas, que são responsáveis por processar os dados e extrair padrões complexos. O número de camadas ocultas e de neurônios em cada camada pode variar, dependendo da complexidade da tarefa e da arquitetura da rede. Assim, cada neurônio em uma camada oculta aplica uma função de ativação, que introduz não-linearidade ao modelo, permitindo que a rede aprenda padrões mais sofisticados.

Camada de Saída: A camada final da rede neural, onde a resposta final é fornecida. Os nós desta camada produzem a saída da rede, que pode ser uma classificação, uma previsão, ou qualquer outro tipo de resultado desejado, dependendo da tarefa.

As conexões entre esses nós têm “pesos” que determinam a importância de uma conexão específica. Então, o processo de treinamento ajusta esses pesos para minimizar o erro entre a previsão da rede e os resultados reais.

Funcionamento das Redes Neurais

Redes neurais operam por meio de um processo de aprendizado supervisionado que envolve duas etapas principais: forward propagation e backpropagation.

Forward Propagation: Durante a propagação para frente, o sistema transmite a informação da camada de entrada até a de saída, passando pelas camadas ocultas. Assim, em cada nó, ele multiplica as entradas pelos pesos das conexões e soma os resultados. Em seguida, uma função de ativação é aplicada ao resultado para decidir se o neurônio deve ser ativado (ou seja, se deve passar a informação adiante). Funções de ativação comuns incluem a sigmoid, tanh, e ReLU (Rectified Linear Unit), cada uma com propriedades específicas que influenciam como os dados são processados.

Backpropagation: Após a rede realizar uma previsão, o sistema calcula o erro (a diferença entre a previsão e o valor real). Em seguida, a rede propaga esse erro de volta, ajustando os pesos das conexões para reduzir o erro nas predições futuras. O processo se repete várias vezes durante o treinamento, utilizando algoritmos de otimização, como o gradiente descendente, para ajustar os pesos e melhorar a precisão da rede.

Tipos de Redes Neurais

Existem vários tipos de redes neurais, cada uma projetada para resolver problemas específicos:

Redes Neurais Artificiais (ANNs): São as mais básicas e generalistas, usadas em uma ampla gama de aplicações. Elas contêm uma ou mais camadas ocultas entre a camada de entrada e saída, sendo adequadas para tarefas simples de classificação e regressão

Redes Neurais Convolucionais (CNNs): Especializadas em tarefas de visão computacional, como reconhecimento de imagens e detecção de objetos. As CNNs utilizam camadas de convolução que aplicam filtros sobre os dados de entrada, permitindo a detecção automática de padrões espaciais, como bordas, texturas e formas, o que as torna extremamente eficazes em processamento de imagens e vídeos.

Redes Neurais Recorrentes (RNNs): Desenvolvidas para lidar com dados sequenciais, como séries temporais e linguagem natural. Dessa forma, as RNNs têm conexões cíclicas que permitem que a rede mantenha uma memória de entradas anteriores, essencial para tarefas onde o contexto histórico influencia a saída atual, como tradução automática e análise de sentimentos.

Redes Neurais de Longa Memória de Curto Prazo (LSTM): Um tipo avançado de RNN projetado para aprender dependências de longo prazo. Ou seja, as LSTMs são eficazes em tarefas complexas como tradução de linguagem natural, síntese de texto e reconhecimento de fala, onde é necessário preservar informações ao longo de longas sequências de dados.

Aplicações de Redes Neurais

Empresas aplicam redes neurais em diversas áreas, revolucionando a maneira como processam dados e tomam decisões.

Visão Computacional: Elas utilizam redes neurais em sistemas de reconhecimento facial, análise de imagens médicas, diagnósticos automatizados e veículos autônomos para interpretar o ambiente.

Processamento de Linguagem Natural (NLP): Aplicações incluem tradutores automáticos, assistentes virtuais como Siri e Alexa, chatbots, e sistemas de análise de sentimentos que processam e interpretam textos em linguagem natural.

Jogos e Simulações: Empresas utilizam redes neurais para criar agentes de IA que aprendem a jogar jogos complexos ou simular comportamentos humanos, como em jogos populares como xadrez e Go, onde já superaram jogadores humanos.

História e Evolução

Finanças: No setor financeiro, empresas utilizam redes neurais para prever mercados, analisar riscos, detectar fraudes e implementar sistemas de negociação automatizada, onde a precisão e rapidez na análise de grandes volumes de dados são essenciais.

A ideia de redes neurais tem raízes profundas na ciência da computação e na neurociência. Em 1943, Warren McCulloch e Walter Pitts introduziram o primeiro modelo matemático de neurônios artificiais, lançando as bases para o desenvolvimento delas. Nos anos 1950, Frank Rosenblatt desenvolveu o perceptron, uma rede neural simples que poderia aprender a classificar padrões, apesar de suas limitações.

Nos anos 1980, o campo das redes neurais sofreu uma revolução com a introdução do algoritmo de retropropagação por Geoffrey Hinton, David Rumelhart e Ronald Williams. Assim, esse avanço permitiu o treinamento eficaz de redes mais profundas, abrindo caminho para o desenvolvimento de arquiteturas mais complexas que hoje conhecemos como deep learning.

Quer saber mais sobre redes neurais, confira o vídeo abaixo:

Desafios e Futuro das Redes Neurais

Apesar dos enormes avanços, as redes neurais enfrentam desafios significativos. Um dos maiores desafios é a necessidade de grandes volumes de dados etiquetados para treinamento, o que pode ser caro e demorado para obter. Além disso, as redes neurais exigem considerável poder computacional, especialmente ao lidar com arquiteturas profundas, o que pode limitar seu uso em dispositivos com recursos limitados.

Entretanto, para superar esses desafios, pesquisadores estão explorando novas abordagens, como redes neurais neuromórficas, que tentam replicar mais de perto a estrutura do cérebro humano, e técnicas de otimização como quantização e compressão de redes, que visam reduzir o consumo de energia e melhorar a eficiência.

O futuro das redes neurais é promissor, com potenciais desenvolvimentos em áreas como inteligência artificial geral (AGI), onde as máquinas poderão aprender e executar uma ampla gama de tarefas com pouca ou nenhuma intervenção humana. Enfim, redes neurais têm o potencial de transformar indústrias inteiras, à medida que continuam a evoluir e se tornar mais acessíveis.

Conclusão

Redes neurais são uma tecnologia revolucionária que tem o potencial de mudar o mundo. Desde aplicações em saúde até inteligência artificial geral, o impacto delas só tende a crescer. Com contínuos avanços em algoritmos, arquitetura e hardware, o futuro das redes neurais promete ser ainda mais excitante e transformador.

Quer saber mais sobre workstations, computadores e tecnologia da informação? Então continue acompanhando o nosso blog e redes sociais. Está em busca de soluções personalizadas para workstations? Clique aqui e saiba mais!

Foque no seu trabalho, nós proporcionamos o hardware ideal para seus projetos!

Soluções customizadas de hardware para sua necessidade.

FALAR COM ESPECIALISTA